2024-09-21

分享到

尽管去年企业投资总体下降,但对生成式 AI 的投资却大幅增长。今年报告的主编Nestor Maslej 告诉 Spectrum,这种繁荣预示着 2023 年的更广泛趋势,因为世界正在努力应对 ChatGPT 和图像生成 DALLE2 等生成式 AI 系统的新功能和风险。 此外,生成式 AI 的私人投资大部分发生在美国。

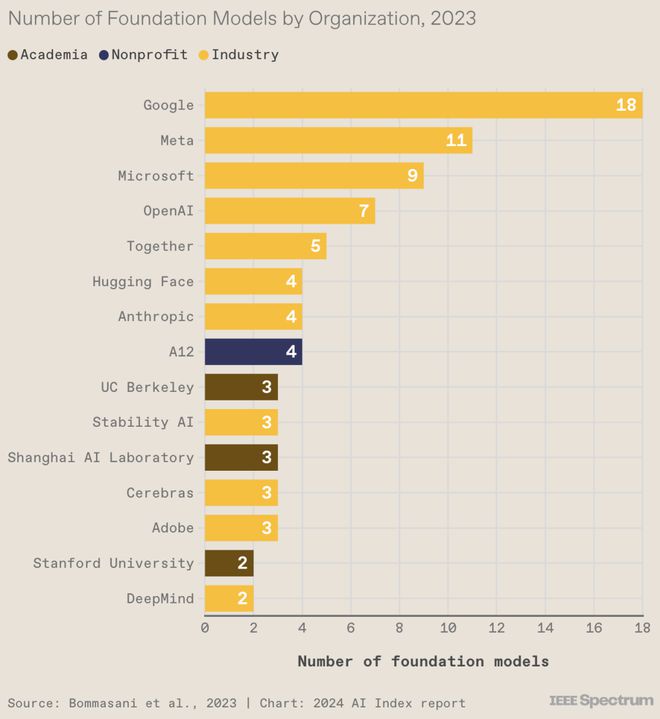

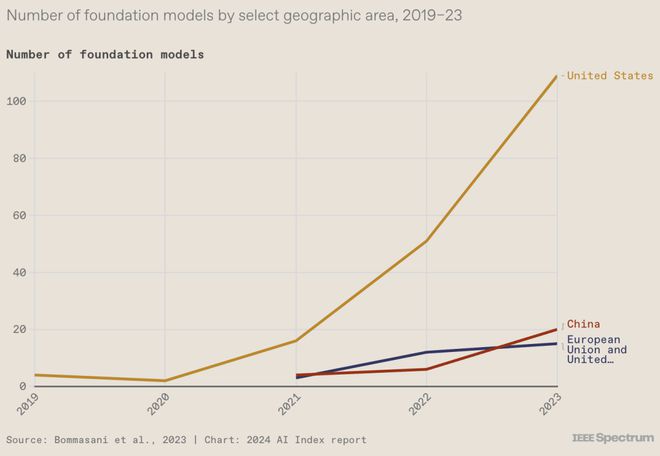

基础模型是大型多用途模型,例如,OpenAI 的 GPT-3 和 GPT-4 是使 ChatGPT 用户能够编写代码或莎士比亚十四行诗的基础模型。由于训练这些模型通常需要大量资源,因此工业界现在制造了大部分模型,而学术界只提供了少量资源。

公司发布基础模型既是为了推动最先进的技术发展,也是为了为开发人员提供构建产品和服务的基础。谷歌在 2023 年发布了最多的内容。

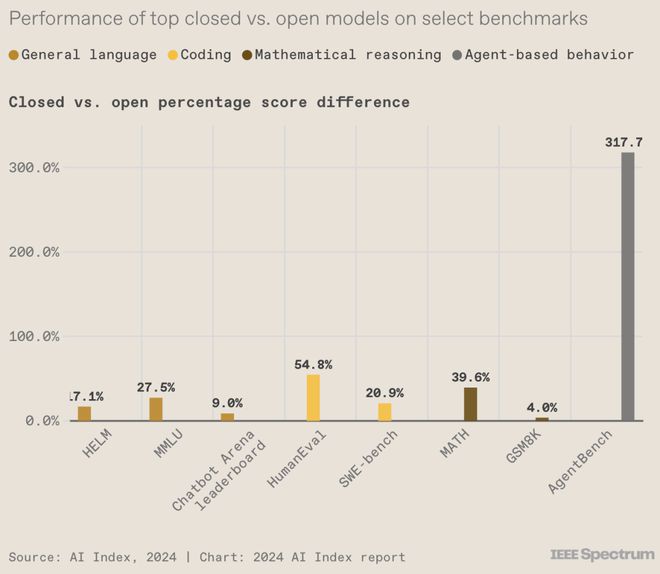

目前 AI 领域的热门争论之一是基础模型应该开源还是封闭,一些人激烈地认为开放模型是危险的,而另一些人则坚持开放模型驱动创新。AI 指数并没有介入这场争论,而是着眼于诸如已发布了多少开放式和封闭式模型等趋势(此处未包含的另一张图表显示,在 2023 年发布的 149 个基础模型中,有 98 个是开放式的, 23 个通过 API 提供了部分访问权限,28 个已关闭)。

这张图揭示了另一个方面:在许多常用的基准测试中,封闭模型的表现优于开放模型。关于开放式与封闭式的争论“通常围绕风险担忧,但很少讨论是否存在有意义的性能权衡”。

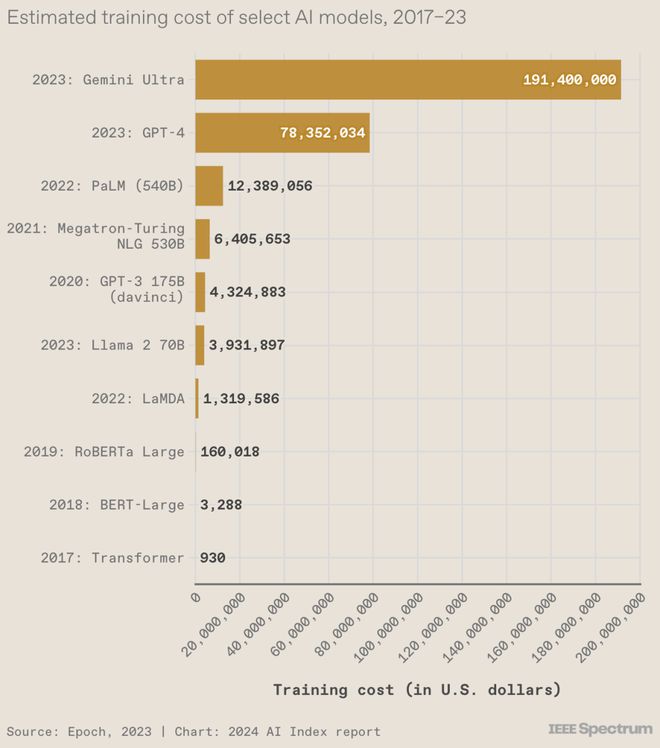

培训一个大模型需要大量资金。AI 研究组织 Epoch AI 做出了一项成本估算,Epoch 团队利用从出版物、新闻稿和技术报告中收集的信息“分析了培训持续时间以及培训硬件的类型、数量和利用率”。

有趣的是,谷歌 2017 年的 Transformer 模型引入了支撑当今几乎所有 LLM 的架构,训练费用仅为 930 美九游体育元。

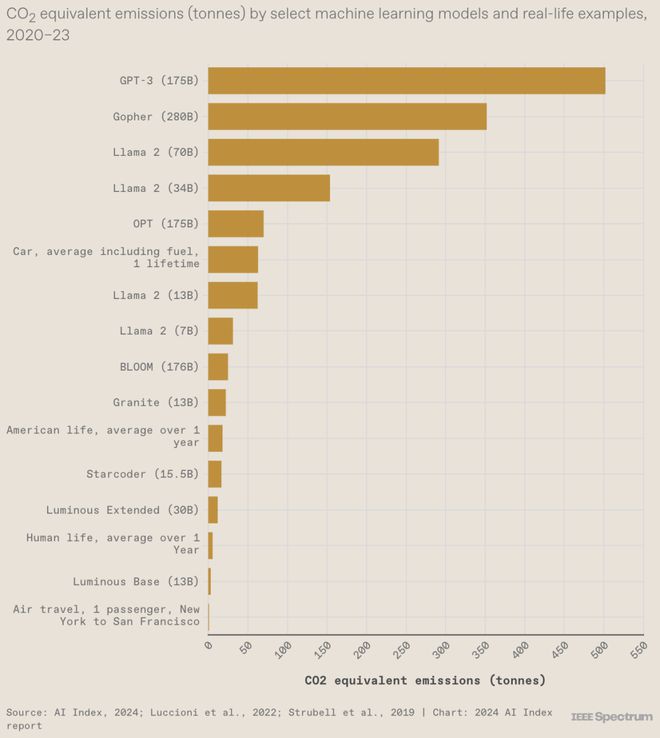

AI Index 团队还估算了某些 LLM 的碳足迹。报告指出,模型之间的差异是由于模型大小、数据中心能源效率和能源网碳强度等因素造成的。

另外,报告还提到了对与推理相关的排放的初步猜测,虽然每次查询的推理排放量可能相对较低,但当模型每天被查询数千次甚至数百万次时,总影响可能超过训练的影响。

由于生成式 AI 领域获得大量投资并发布大量令人兴奋的模型的数据,2022 年(该指数有数据的最近一年),北美 70% 的新 AI 博士在工业界就业,这是过去几年趋势的延续。

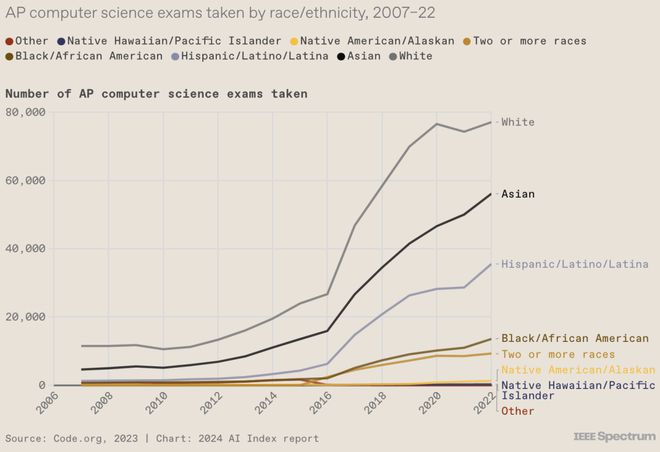

今年的报告提到,参加 AP 计算机科学考试的非白人和女性学生数量正在增加。上图显示了种族趋势,如今参加考试的学生中有 30% 是女孩。

在本科阶段,获得计算机科学学士学位的北美学生的种族多样性也呈现出积极的趋势,尽管获得计算机科学学士学位的女性人数在过去五年中几乎没有变化。

企业已经意识到 AI 的可能性,该指数从市场情报公司 Quid 获取了有关财富 500 强公司财报电话会议的数据,并使用自然语言处理工具扫描所有提及“AI”、“机器学习”、“ML”和“深度学习。”

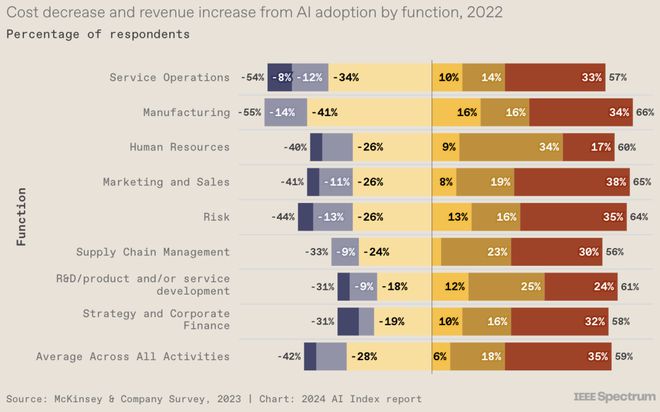

数据显示,近 80% 的公司在电话会议中讨论了 AI。若企业领导者担心,如果他们不使用这项技术,他们就会错过机会。虽然其中一些闲聊可能只是首席执行官们闲聊流行语,但在麦肯锡的一份调查中提到, 55% 的公司已经在至少一个业务部门实施了 AI 技术。

总体而言,42% 的受访者表示成本降低了,59% 的受访者声称收入增加了。报告还提到,这种对利润的影响反映了效率的提高和工人生产力的提高。

2023年,不同领域的多项研究表明,AI 使工人能够更快地完成任务并生产出更高质量的工作。

一项研究着眼于使用 Copilot 的程序员,而其他研究则着眼于 Agent 和 LLM。研究表明,尽管每个工人都受益,但 AI 对低技能工人的帮助比对高技能工人的帮助更大。

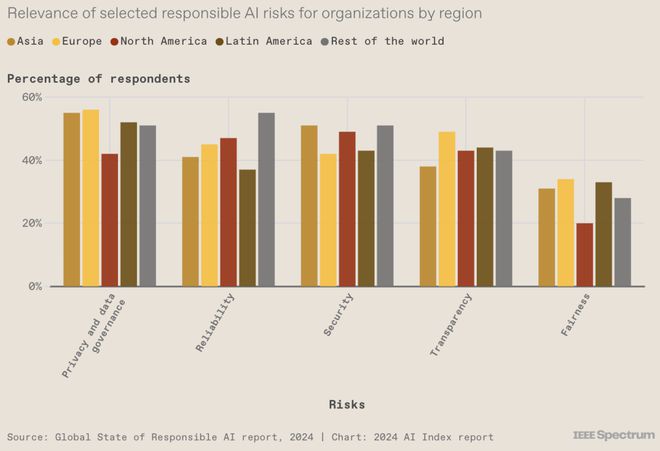

今年,AI Index 团队对全球 1000 家收入至少 5 亿美元的公司进行了调查,以了解企业如何看待负责任的 AI。

结果表明,隐私和数据治理被认为是全球最大的风险,而公平性(通常在算法偏差方面讨论)仍然没有得到大多数公司的认可。

此外,报告还提到,企业正在针对其感知的风险采取行动:跨地区的大多数组织都实施了至少一项负责任的 AI 措施来应对相关风险。

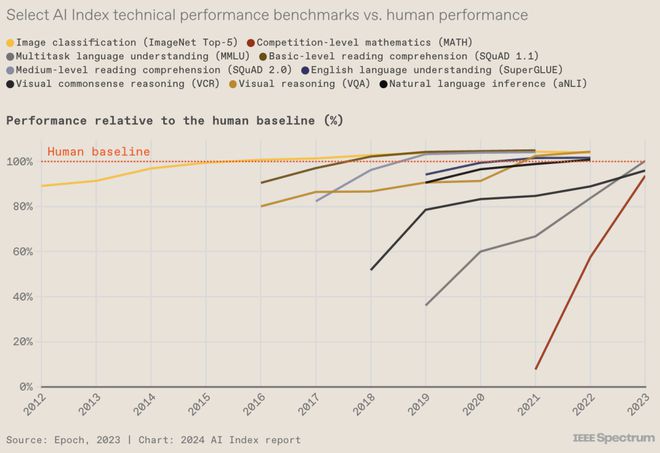

AI 在近年一系列任务上的表现都优于人类,包括阅读理解和视觉推理,且 AI 性能改进的步伐也在加快。

现在,针对竞赛级别的数学引入了新的基准,AI 从 30% 开始,然后在一年内达到 90%。虽然人类在复杂的认知任务中仍然表现优于 AI 系统,但明年可能未必。

当 AI 公司准备发布大型模型时,标准做法是根据该领域的流行基准对其进行测试,从而让 AI 社区了解模型在技术性能方面如何相互比较。

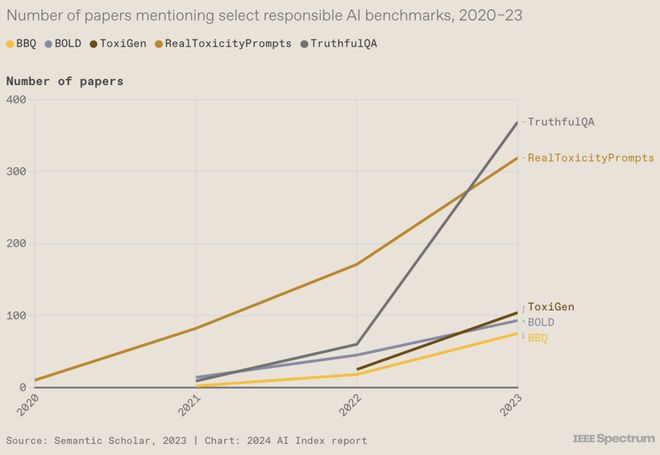

然而,根据负责任的 AI 基准测试模型的情况并不常见,这些基准评估有毒语言输出(RealToxicityPrompts和ToxiGen)、响应中的有害偏差(BOLD和BBQ)以及模型的真实程度(TruthfulQA)等。

这种情况开始发生变化,因为人们越来越意识到,根据这些基准检查模型是负责任的事情。此外,报告还提到了缺乏一致性:开发人员正在根据不同的基准测试他们的模型,这使得比较变得更加困难。

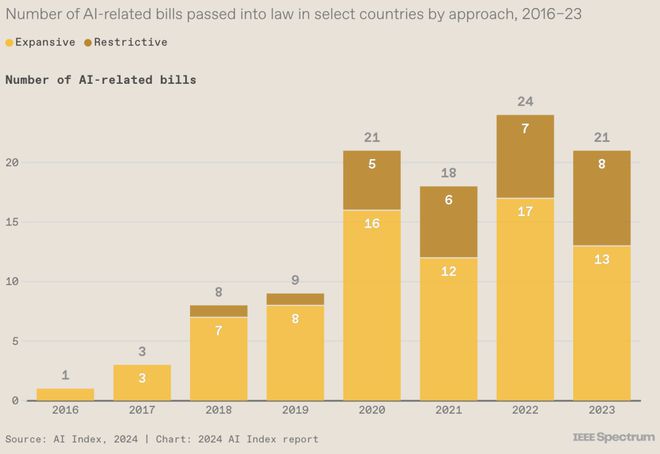

2016~2023 年间,AI 指数发现,有 33 个国家通过了至少一项与 AI 相关的法律,其中大部分行动发生在美国和欧洲。

在此期间,总共通过了 148 项与 AI 相关的法案,该指数研究人员还将法案分为旨在增强国家 AI 能力的扩张性法律或限制 AI 应用和使用的限制性法律。尽管许多法案继续推动 AI 发展,但研究人员发现全球存在限制性立法的趋势。

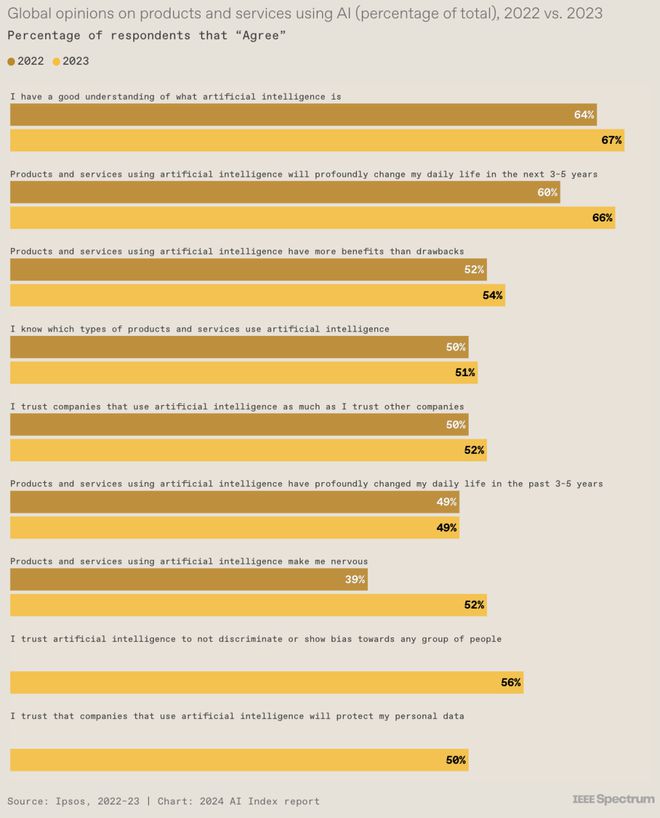

调查显示,来自 31 个国家的 22816 名成年人(16 岁~ 74 岁),超过一半的受访者表示 AI 让他们感到紧张,这一比例高于去年的 39%。

三分之二的人现在预计 AI 将在未来几年深刻改变他们的日常生活,年轻人更倾向于对 AI 将如何改变他们的生活持乐观态度。

有趣的是,悲观情绪很多来自西方发达国家,而印度尼西亚和泰国等地的受访者则表示,他们预计 AI 利大于弊。

回顾 2023 年至今,大部分 AI 炒作都集中在基础模型的横向能力上,但 AI 的真正机会在于,。

PS:完整报告同步在星球了,近期也分享了其他最新的海外行业报告与数据,加入星球领取

2、「AI 天使汇」联合 150 家顶级基金/站投将举办新一轮 AI 创业项目路演活动,征集优秀创业者报名参与,报名方式如下: